網路駭客濫用生成式 AI (GenAI) 的情況正在急速攀升,就在我們介紹了 Gen AI 如何被用於網路犯罪的短短幾個禮拜之後,隨即又出現了新的重大進展。駭客正在大量推出各種犯罪用大型語言模型 (LLM) 以及Deepfake(深偽技術),不僅數量更多、範圍也更廣。

網路駭客濫用生成式 AI (GenAI) 的狀況正在急速攀升,就在我們介紹了 Gen AI 如何被用於網路犯罪的短短幾個禮拜之後,隨即又出現了新的重大進展。駭客正在大量推出各種犯罪用大型語言模型 (LLM) 以及Deepfake(深偽技術)視訊詐騙,不僅數量更多、範圍也更廣。

以下是有關這項議題的最新發展。

犯罪用LLM(大型語言模型):舊的浮出水面,新的不斷湧現

我們持續看到犯罪用 LLM 產品不斷出現,不論是現有或全新的產品。Telegram 上的犯罪市集不斷在廣告各種類似 ChatGPT 的最新聊天機器人,宣稱不會過濾任何意圖不良的詢問。儘管它們通常不會明講,但我們相信這些許多都是所謂的「越獄服務」(jailbreak-as-a-service) 的前端窗口。

正如我們在上次的文章中提到,商用 LLM (如 Gemini 或 ChatGPT) 在設計上會拒絕回答一些被判定為惡意或不道德的詢問 (如以下圖 1 所示)。

AI的黑暗面:LLM淪為犯罪工具

網路上已經可以看到多款類似 ChatGPT 的犯罪用 LLM 產品,它們提供了不受限制的犯罪相關功能。駭客集團宣稱提供可保證私密性和匿名性的聊天機器人,這些機器人是使用惡意資料所特別訓練出來,包括:惡意的原始程式碼、方法、技巧以及其他犯罪策略。

駭客之所以需要這類功能,正是因為商用 LLM 通常會拒絕一些疑似意圖不良的要求。除此之外,駭客集團通常也會避免直接使用 ChatGPT 這樣的服務,因為害怕被追蹤或曝光。

越獄服務的前端窗口據稱可以繞過這類審查機制,因為他們會將使用者的惡意要求包裝成特殊的提示,藉此騙過商用 LLM,誘導它提供未經過濾的回應。

原本被認為已經消失的舊式犯罪用 LLM 最近也再度現身,例如據稱去年就已終止開發的 WormGPT 和 DarkBERT (請參閱我們的 這篇文章) 最近又重出江湖。

WormGPT 一開始是一個 葡萄牙程式設計師的專案,並且在 2023 年 8 月已公開宣布終止。然而網路犯罪商店最近卻在銷售三種不同版本的 WormGPT:「原始版」(第 1 版)、「進階版」(第 2 版),以及「終極版」(第 3 版)。不過,他們並未說明三者之間的差異。因此,我們不確定這些市場上的新版 WormGPT 是否為舊專案的延續,或者是全新開發的專案,只是看上它的知名度而刻意借用相同的名稱。

另一方面,DarkBERT 是一個犯罪用聊天機器人,這是一位名叫「CanadianKingpin12」的駭客所開發的某產品當中的一項功能。這從許多徵兆看來應該只是一起詐騙,因為它與另外四個犯罪用 LLM 一起販售,而且功能非常類似。全部四項服務都出現在同一廣告貼文中,而該貼文在一星期後就被下架,而且之後就沒再看過。

值得一提的是,一個名為 DarkBERT 的合法專案確實存在,這是一個由網路資安廠商使用暗網上的貼文訓練出來的 LLM,用來定期對地下論壇上的資料進行自然語言處理 (NLP) 工作。

新版的 DarkBERT 和 WormGPT 特別值得一提的是,兩者都是以應用程式的形式販售,並提供了「Siri 套件」的選項。我們猜測這應該是個語音功能選項,就像 Humane 胸針與 Rabbit R1 裝置一樣,是設計來與 AI 聊天機器人互動用的。巧的是,2024 年 Apple 全球開發者大會 (WWDC) 上也宣布了下一代 iPhone 將具備同樣的功能。如果屬實的話,這將是駭客集團首次在創新上超越正規企業。

除此之外,我們還發現了其他的犯罪用 LLM,如:DarkGemini 與 TorGPT。兩者都使用了讓人聯想到現有技術的名稱 (Gemini 是 Google 的聊天機器人,而 TOR 則是強調私密性的通訊網路)。不過,它們的功能除了能處理圖片之外,似乎與其他犯罪用 LLM 產品差不多。TorGPT 宣稱除了一般的 LLM 服務之外,還提供了影像生成服務。

儘管有這些功能,但犯罪用影像生成服務的市場似乎發展得比其他 AI 產品更慢,這或許是因為駭客集團還有一些其他服務可用 (如 Stable Diffusion 或 DALL-E),或者也可以使用深偽生成工具 (如果是針對性的攻擊的話)。

除此之外,我們還看到另一個犯罪用 LLM 的廣告,叫作「Dark Leonardo」,但我們無法判斷這名稱是不是暗指某個已知產品,例如 DarkGemini 和 TorGPT 的情況。我們能想到最接近的應該是暗指 OpenAI 的 DaVinci,也就是 GPT-3 所用的其中一個模型。

Deepfake深偽/視訊影音詐騙-AI換臉無所不在:你的臉安全嗎?

歹徒追求更有效率地自動化生成讓人信服的深偽圖片和影片的情況達到了巔峰,我們看到有越來越多犯罪集團提供可天衣無縫地變造圖片和影片的應用程式,開啟了更多詐騙類型與社交工程技巧的大門。

其中一個軟體據稱可以幫任何人「脫衣」:DeepNude Pro 的廣告宣稱,使用者只要輸入一張某人穿著衣服的照片,該軟體就能生成一張此人沒穿衣服的照片。使用者甚至可以選擇圖片中的身體特徵大小和形狀。

更令人擔憂的是,儘管這並非什麼新鮮技術,但卻越來越容易被任何不肖分子取得,就連缺乏技術能力的人也能使用。

在過去,這類變造手法的主要目標通常是名人,但現在,任何人,甚至未成年人或未經同意的成年人都可能成為受害者,尤其在社群媒體的持續擴散下。事實上,美國聯邦調查局 (FBI) 已發出警告指出深偽被用於性愛勒索與恐嚇犯罪所帶來的風險。

此外,其他深偽(Deepfake)生成技術相關的新工具也開始紛紛出現,儘管這類工具提供的功能全都大同小異,不過應用情境卻截然不同,為不同的犯罪型態開啟了大門。

首先是 Deepfake 3D Pro,它可從一個人的照片產生一個 3D 虛擬分身。這個虛擬分身還可套用一段現有的錄音或使用另一個語音模型來全新產生一段錄音,就能讓虛擬分身講話。為了讓虛擬分身看起來更加逼真,它的眼睛還會經常看著不同的方向,就像真人在講話時一樣。

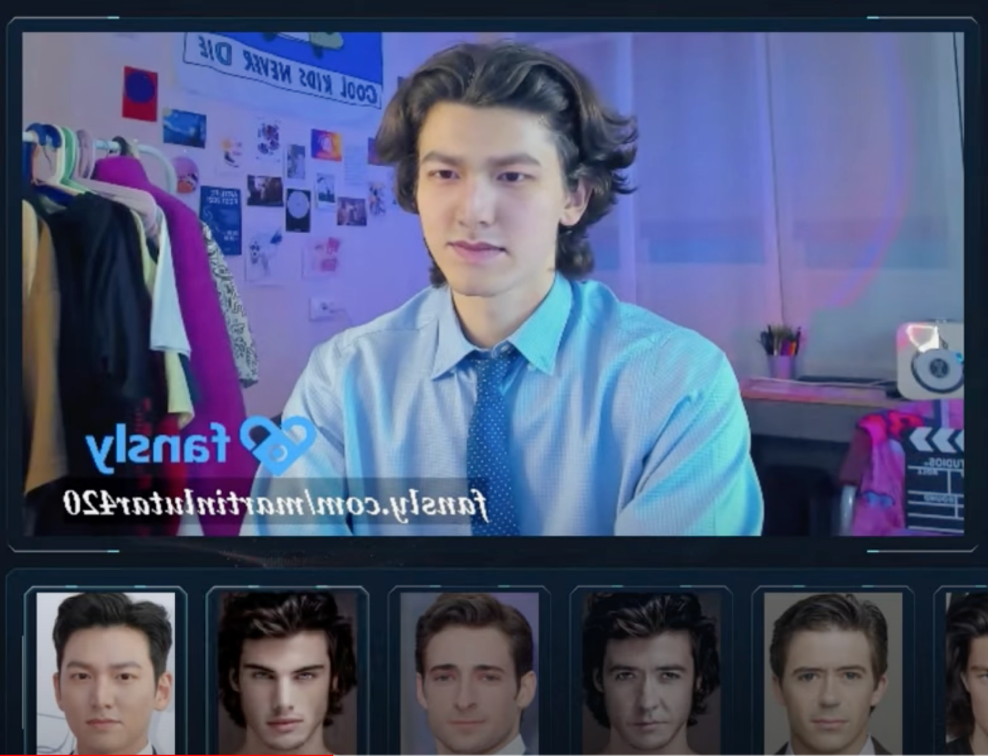

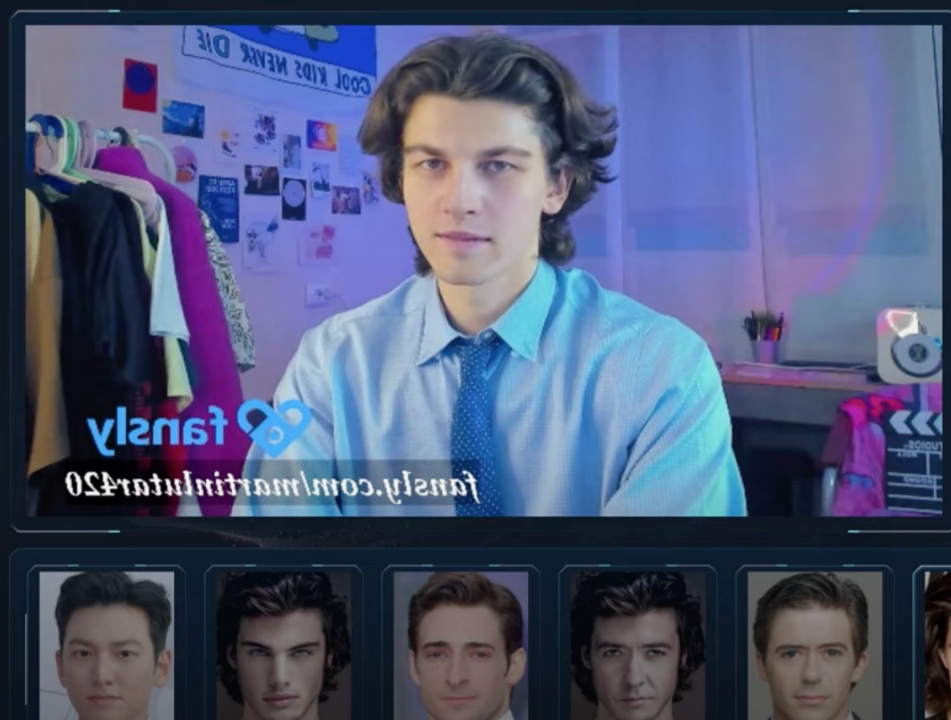

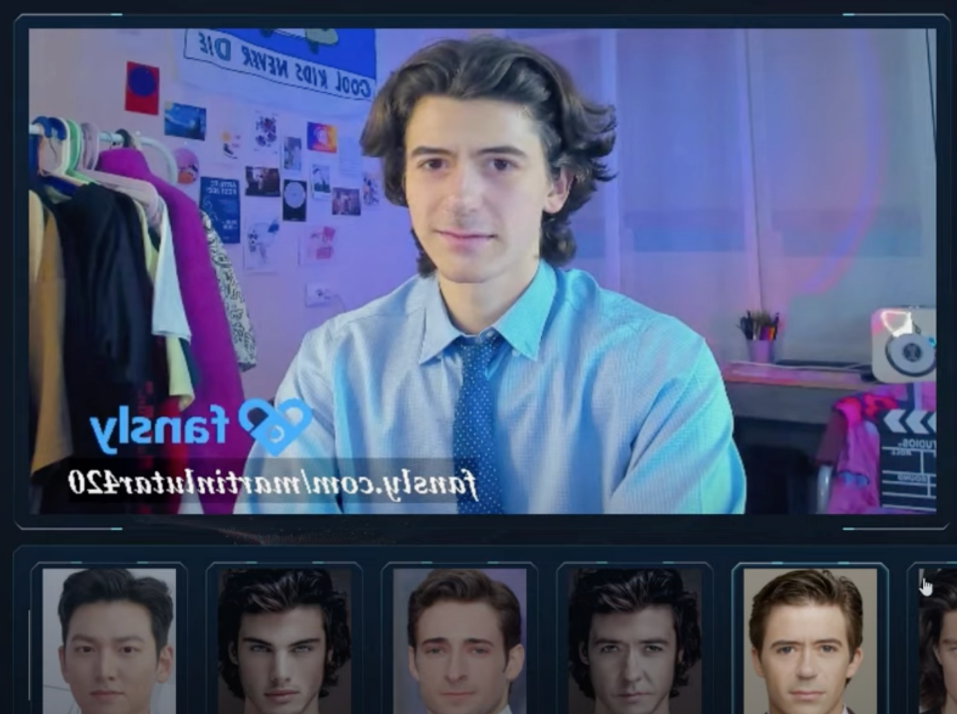

此外,市場上還有一些名叫 Deepfake AI、SwapFace 和 AvatarAI VideoCallSpoofer 的應用程式。如果它們廣告的是真的,那麼這些應用程式就能將某段影片中的臉孔換成另一張臉,只要透過一張或幾張照片即可。不過,每一套產品在運作上還是有些關鍵的差異。

例如 Deepfake AI 支援的是預錄的影片,但 SwapFace 則是一個即時視訊過濾器,甚至還支援熱門的視訊串流工具,如: Open Broadcast Software (OBS)。

Avatar AI VideoCallSpoofer 則如同 Deepfake 3D Pro 一樣,可從一張照片製作出逼真的 3D 虛擬分身。主要差別在於,Avatar AI 可即時追蹤臉部的動作。

這樣的發展再次印證深偽製作技術正從一種特殊技術演變成幾乎每個駭客都能取得的技術,開啟了各種犯罪應用情境,而且還能互相搭配。以下介紹幾種這類技術可能的濫用方式。

Deepfake 3D Pro 與其虛擬分身製作功能可用來騙過金融機構的 Know-Your-Customer (KYC) 用戶驗證系統,讓犯罪集團使用偷來的身分證取得帳戶的使用權。此外也還搭配聲音模仿服務,根據腳本預錄一段影片,用於網路釣魚詐騙。因為該軟體可讓網路駭客製作名人或其他影響力人士的虛擬分身,然後用這個分身來照稿宣傳某種新的投資機會 (實際上是詐騙),甚至在影片中提到詐騙對象的名稱來拉近彼此的距離。

至於 Deepfake AI 則是讓深偽技術更容易取得,任何人都能拿一張他人的照片然後將其臉孔移植到一段影片的主角上,藉此破壞其名聲,或者散播假訊息。這不僅可以變成攻擊名人的武器,也可能用來針對任何人,甚至是一般市井小民。

SwapFace 與 Avatar AI VideoCallSpoofer 兩者都具備了即時的視訊換臉功能。因此可用來從事深偽視訊電話詐騙,就像 2024 年 2 月發生的案例一樣,受害的金融機構員工因為被深偽視訊電話所騙而匯款了 2,500 萬美元給歹徒。

結論

深偽生成工具的精密度顯然又更上層樓,即使聊天機器人和 LLM 已經讓詐騙手法變得更精密、更具說服力,但我們相信,未來更大的災難將來自於使用深偽影片來開發新式社交工程手法的犯罪集團。這類技術不僅讓原本的手法更上層樓,而且更帶來了新的原創詐騙手法。未來幾個月內,這些手法毫無疑問地將獲得更多網路犯罪集團的青睞。

犯罪用 LLM 的需求一直在緩慢、但穩定地成長,只不過我們目前仍未看到真正的犯罪用 LLM 出現,廣告中宣傳的其實大部分都只是越獄服務,不然就是來蹭熱度的單純詐騙。

我們也看到犯罪用 LLM 開始發展出不同的形態,例如 DarkGemini 用來處理照片,而 TorGPT 則是直接在 UI 上提供影像生成功能。

此外,深偽應用程式及服務也越來越容易取得、安裝及執行,同時還出現了更多進階深偽功能。這意味著,深偽正慢慢從假新聞製造集團與國家級駭客集團手中下放到一般犯罪集團手上,應用在一些更普通的用途:詐騙和勒索。網路駭客現在比以往擁有更多選項,同時,潛在的受害族群也在不斷增加。

今日的使用者比以往更需要隨時保持警戒。隨著網路駭客濫用 AI 來捏造事實以取信於人,使用者對任何資訊都應徹底檢驗其真實性,尤其是網路上的資訊。除此之外,使用者也可使用Deepfake Inspector來防範視訊電話中的 AI 換臉詐騙。此工具可以掃描視訊內容是否有被 AI 修過的跡象,因為這很可能是深偽換臉詐騙的徵兆。使用者可在加入視訊電話時啟用這項工具,就可以在偵測到 AI 生成內容或深偽內容時收到警告。

更多有關 AI 犯罪應用的研究:

- 2023 年 8 月:熱潮還是現實:AI 在網路犯罪地下市場上的現況 (Hype vs. Reality AI in the Cybercriminal Underground)

- 2024 年 5 月:回顧 AI 風潮:網路駭客使用生成式 AI 的最新發展

原文出處:Surging Hype–An Update on the Rising Abuse of GenAI 作者:David Sancho 與 Vincenzo Ciancaglini