藝人王仁甫揭露了詐騙集團利用AI聲紋辨識系統進行詐騙的案例。他的女兒接到假借市場調查的電話,收集了她的聲紋。隨後,王仁甫的老婆季芹接到詐騙電話,內容竟是女兒的聲音,要求匯款。這種利用AI變聲技術進行詐騙的手法,讓王仁甫直呼「很恐怖」,並已報警處理。此事件提醒民眾,對於陌生來電應提高警覺,切勿輕易透露個人資訊,以防受騙。

☞ 延伸閱讀:兒子來電聲稱手機壞掉,要重新加LINE?七旬老翁急匯款 38 萬,險遭AI詐騙

網路釣魚手法不斷推陳出新,從過去的釣魚信件、釣魚簡訊,到如今 AI 加持的「分聲詐騙」和「分身詐騙」,網路釣魚手法已經變得更為精密且難以辨識。現在詐騙集團不僅能模仿家人朋友的聲音,甚至能打造一模一樣的影像來假扮親近的人,讓受害者防不勝防。無論是哪一種犯罪手法,其目的都在誘騙人們提供敏感資料 (如密碼或信用卡資料)、點選惡意連結,或下載危險檔案。歹徒會冒充一些值得信任的對象,例如:銀行、政府機關、知名企業,或是您的家人和朋友,然後誘騙受害者做出一些損害其隱私或安全的行為。

近期出現了一種新型態的詐騙手法。駭客利用 AI 技術,結合電話和釣魚郵件,誘騙用戶交出帳戶備用碼,這種新型詐騙通常從一通假冒 Google 官方人員的電話開始,聲稱用戶的 Gmail 帳戶出現異常活動。接著,用戶會收到一封看似來自 Google 的電子郵件,要求提供帳戶備用碼,以恢復帳戶。一旦用戶交出備用碼,駭客就能完全掌控其 Gmail 帳戶。提醒您,切勿點擊任何可疑連結或下載不明檔案,輸入個資前務必確認網站安全性。同時,建議使用密碼管理器和定期監控帳戶活動,以確保帳戶安全。

繼續閱讀

分類: Deepfake(深偽技術)

趨勢科技研究發現:超過三分之二的人都擔心深偽 (Deepfake) 視訊換臉詐騙

深偽 (Deepfake)詐騙,也就是俗稱的 AI 視訊換臉/換聲,對網路資安與資訊交換帶來了嚴重的挑戰。趨勢科技近期在 2024 年 6 月下旬至 7 月中旬針對消費者對於深偽的認知、經驗及疑慮做了一份深入研究,披露了深偽對於網路資安以及社會大眾認知的廣泛影響。

認知與接觸情況

這份研究調查了美國與澳洲共 2,097 名受訪者,目的是要了解消費者對於深偽的認識、接觸情況以及疑慮。其中一項重要發現就是:受訪者對深偽有很高的認知,不過卻存在著明顯的世代差異。該研究特別篩選出熟知「Deepfake」一詞的受訪者,因此在年齡 55 和更老的族群當中,不合資格的比例偏高,尤其在澳洲。這突顯出加強特定對象的教育以消除數位素養落差的必要性。

受訪者接觸深偽的情況相當普遍,有 80% 的受訪者都曾遇到過深偽圖片,有 64% 曾看過深偽影片、48% 聽過深偽音訊。社群媒體平台是這類接觸的主要來源,突顯出深偽在數位世界極為普遍的現象。有趣的是,有很大部分受訪者表示他們有能力分辨深偽:57% 可分辨圖片、48% 可分辨影片、45% 可分辨音訊。這顯示人們對於這類被篡改內容的認知越來越高,至少在目前偽造品質還不佳的時候。

但事實上,隨著深偽技術的持續進步,人類肉眼已經越來越難可靠地分辨深偽,這正是為何趨勢科技最近會推出一個叫做「Deepfake Inspector」的「免費」工具來協助您即時確保視訊通話的安全。此外,也請參考我們的最佳實務原則來避免自己受到深偽的危害。

什麼是 Deepfake(深偽)?為什麼你我都可能成為受害者? 辨識深偽視訊詐騙電話的五個祕訣

深偽(Deepfake)是近年最受注目的 AI 資安議題。

隨著生成式 AI 技術快速普及,詐騙集團利用 Deepfake 模仿聲音、臉部、甚至整段視訊,讓你在通話時無法立即分辨真假。

許多人搜尋深偽相關資訊時最常問:

- Deepfake 真的能偽裝成「你認識的人」嗎?

- 視訊電話詐騙怎麼用 AI 假冒?

- 有什麼 AI 工具能幫我辨識深偽?

- 我怎麼知道對方是不是在用換臉詐騙?

本篇,幫你一次看懂深偽詐騙,並學會如何用 AI 工具提升安全。

⟫ 看答案

深偽(Deepfake)指透過生成式 AI 變造的 聲音、影像或文字,讓內容看起來與真實無異。

AI 模型能:

- 複製某人的聲音

- 套用某人的臉

- 模仿說話方式

- 生成看似真實的視訊

這代表,只要詐騙集團取得你的照片、影片或錄音,就能假扮你或你身邊的人。

深偽一詞是「深度偽造」(Deepfake) 的簡稱,涵蓋了所有經過生成式 AI (GenAI) 變造的聲音、視覺或文字內容。會被網路犯罪集團用來獲取財務利益、欺騙與操縱他人。

深偽技術(Deepfake) 詐騙影片是使用人工智慧 (AI) 來產生模仿人們講話或動作的超逼真影片或音訊,就如同他們真的說過那些話或真的做過那些事情一樣。深偽技術正被歹徒用來從事視訊電話詐騙,對一般個人和企業機構都構成了嚴重風險。

當您在進行視訊電話時,您如何知道對方是否為真人,還使用深偽技術做出來的冒牌貨?在一個充斥著深偽的世界,眼見不再為憑,所以,認識及對抗這類技術所帶來的風險,比以往更加重要。欲了解什麼是深偽,以及如何辨識,請參閱這篇「深偽Deepfak是什麼?」(Deepfake 101) 貼文。

繼續閱讀最會演的AI!投資人、HR、愛情暈船者必須了解的三種 Deepfake深偽詐騙影片

提供個人資料。如有任何疑慮,請立即撥打 165 反詐騙專線查證,並主動向平台檢舉,協助促使詐騙內容下架。

Deepfake(深偽技術)詐騙影片、AI 換臉、AI 模仿聲音… 怎麼感覺現在好像再也沒有什麼可以相信的了?在人工智慧 (AI) 的加持下,深偽技術正在迅速發展,這使得真實與虛假的界線越來越模糊。請繼續往下閱讀來了解您 應注意的幾種深偽詐騙。

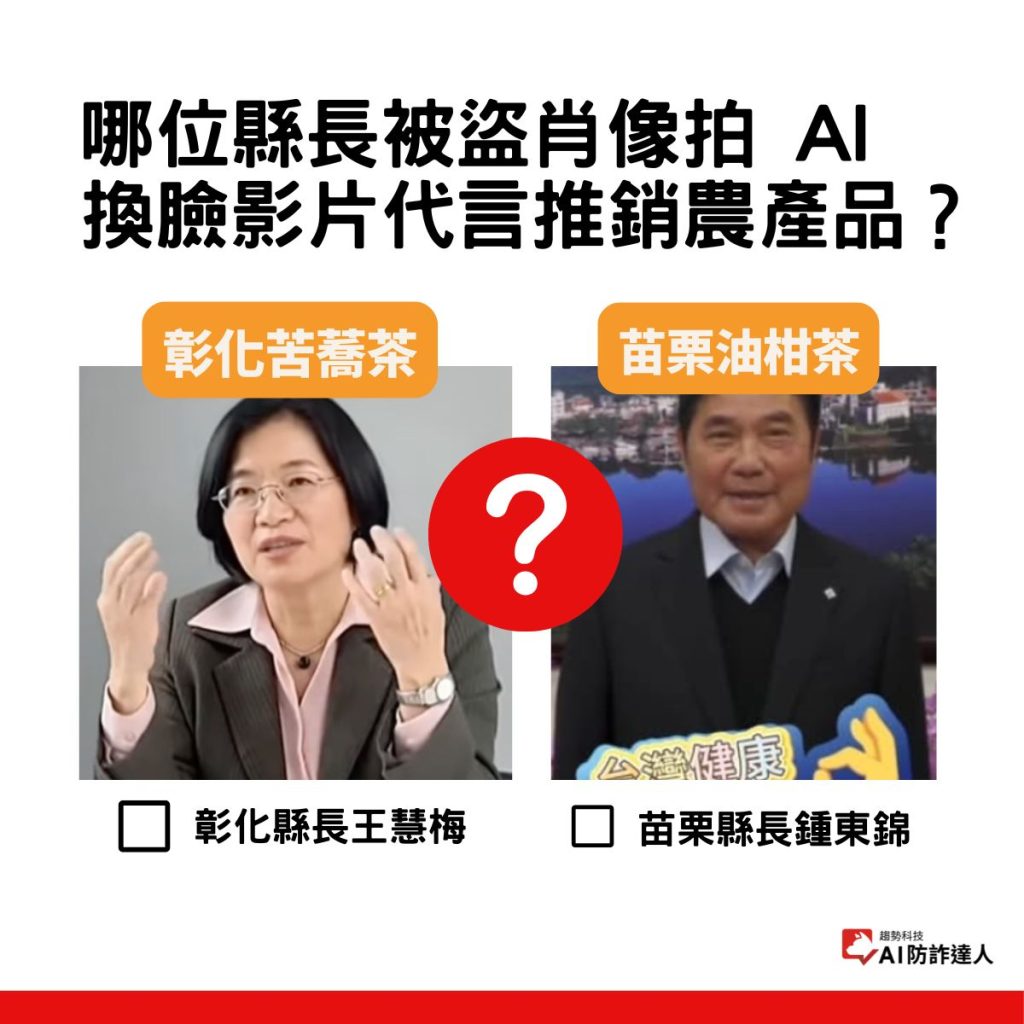

駭客集團會利用深偽來假冒名人、公眾人物或企業高階主管來從事各種不法活動,造成各種嚴重後果,包括財務損失、名譽損失等等。例如,在 AI 的推波助瀾下,性愛勒索變得比以往更加猖獗。深偽技術讓歹徒更容易利用被害者在社群媒體上發布的照片和影片偽造出不雅的內容,藉此勒索或騷擾被害者,為此,美國聯邦調查局 (FBI) 已提出警告。

⟪看梗圖學資安⟫跟汪星人視訊,狗狗認得出你嗎?

你今天好嗎?還再說「累得跟狗一樣嗎?」,兩個跟狗狗有關的日子就要到來:「826國際狗狗日(International Dog Day)」和「99台灣狗狗節」,本文用幾張狗狗迷因梗圖,看看到底你比較累還是狗狗比較累?出差時想念家中的萌寵時,你會跟狗狗視訊嗎?但你確定他認得出你嗎?(最後一張梗圖告訴你答案 (¬‿¬) )。

提到視訊,不得不提到近日升溫的AI詐騙案例,「新北多位里長遭AI換臉合成不雅片勒索,險害家庭革命」、「劉德華現身視訊?粉絲傻傻信,慘遭詐騙264萬」、「數百名AI生成的馬斯克分身用Deepfake換臉詐騙影片,讓退休老人被騙超過千萬!」,你我都可能成為下個受害者,該如何自我保護?

國際狗狗日,今天別再說累得跟狗一樣(•̀ᴗ•́)و ̑̑

⟫ 看答案

⟫ 看答案